Математическое моделирование множественная регрессионная модель пример. Построение и тестирование адекватности эконометрических моделей множественной регрессии: выбор функциональной формы модели

Регрессионный анализ – это наиболее известный метод построения модели идентификации. Он основан на двух предположениях:

- метод применим только к математическим моделям линейным по идентифицируемым параметрам;

- в качестве меры рассогласования математической модели с экспериментальными данными берется сумма квадратов отклонений расчетных и экспериментальных значений выходной величины.

Метод регрессионного анализа включает следующие этапы

- Составление суммы квадратов отклонений расчетных и экспериментальных значений выходной величины (функция ошибки).

- Минимизация функции ошибки. Для этого все частные производные функции ошибки по всем параметрам приравниваются к нулю.

- Решение полученной системы линейных уравнений дает искомые значения параметров.

Идентификация линейной функции

Постановка задачи:

Решить задачу параметрической идентификации и найти параметры a 0 , a 1 , a 2 математической модели, имеющей следующую структуру: y = a 0 + a 1 x 1 + a 2 x 2 ; для наилучшего описания следующих экспериментальных данных.

| Входные воздействия | x1 | 1 | 0 | 1 | 2 |

| x2 | 1 | 1 | 0 | 1 |

|

| Выходное воздействие | y | -1 | -3 | 3 | 1 |

Решение:

1. Составим сумму квадратов отклонений (функцию ошибки):

где N = 4 – количество экспериментов,

y iР – расчетное значение выходного воздействия,

y iЭ – экспериментальное значение выходного воздействия (из таблицы).

2. Минимизируем полученную функцию ошибки:

I(a 0 , a 1 , a 2) -> min

3. Применим необходимое условие существования экстремума (минимума) функции многих переменных.

Если непрерывная дифференцируемая функция имеет в некоторой точке экстремум, то ее градиент (вектор частных производных) равен нулю.

4. Вычислим частные производные функции ошибки и приравняем их к нулю:

5. Решим полученную систему линейных уравнений и находим три коэффициента "a".

Система решается достаточно просто, поэтому не будем расписывать её решение подробно. А ответ таков: a 0 = 1, a 1 = 2, a 0 = -4, то-есть полученная модель выглядит следующим образом: y = 1 + 2*x 1 - 4*x 2 .

Основной целью множественной регрессии является построение модели с большим числом факторов и определение при этом влияния каждого из факторов в отдельности на результат, а так же определение совокупного воздействия факторов на моделированный показатель.

Спецификация модели множественной регрессии включает в себя отбор фактора и выбор вида математической функции (выбор вида уравнения регрессии). Факторы, включаемые во множественную регрессию должны быть количественно измеримы и не должны быть интеркоррелированы и тем более находиться в точной функциональной связи (т.е. должны в меньшей степени влиять друг на друга, а в большей степени на результативный признак).

Включаемые во множественную регрессию факторы должны объяснять вариацию независимой переменной. Например, если строится модель с набором - факторов, то для нее находится значение показателя детерминации , который фиксирует долю объясненной вариации результативного признака за счет - факторов.

Влияние других неучтенных факторов в модели оценивается как соответствующей остаточной дисперсии .

При включении в модель дополнительного фактора значение показателя детерминации должно возрастать, а значение остаточной дисперсии должно уменьшиться. Если этого не происходит, то дополнительный фактор не улучшает модель и практически является лишним, причем введение такого фактора может привести к статистической не значимости параметров регрессии по - критерию Стьюдента.

Отбор факторов для множественной регрессии осуществляется в две стадии:

1. Подбираются факторы, исходя из сущности проблемы.

2. На основе матрицы показателей корреляции определяют статистики для параметров регрессии.

Коэффициенты корреляции между объясняющими переменными , которые еще называют коэффициентами интеркорреляции, позволяют исключить из модели дублирующие факторы.

Две переменные и называют явно коллинеарными, если коэффициент корреляции .

Если переменные явно коллинеарны, то они находятся в сильной линейной зависимости.

При наличии явно коллинеарных переменных предпочтение отдается не фактору более тесно связанному с результатом, а фактору, который при этом имеет наименьшую тесноту связи с другими факторами.

По величине парных коэффициентов корреляции обнаруживается лишь явная коллениарность факторов.

При использовании множественной регрессии может возникнуть мультиколлениарность фактов, т.е. более чем два фактора связаны между собой линейной зависимостью. В таких случаях менее надежным становится МНК при оценке отдельных факторов, результатом чего становится затруднение интерпретации параметров множественной регрессии как характеристик действия фактора в чистом виде. Параметры линейной регрессии теряют экономический смысл, оценки параметров ненадежны, возникают большие стандартные ошибки, которые при этом могут изменяться с изменением объема наблюдений, т.е. модель становится непригодной для анализа и прогнозирования экономической ситуации. Для оценки мультиколлениарности фактора используют следующие методы:

1. Определение матрицы парных коэффициентов корреляции между факторами, например, если задана линейная модель множественной регрессии , то определитель матрицы парных коэффициентов примет вид:

Если значение данного определителя равно 1

,

,

то факторы являются неколлинеарными между собой.

Если между факторами существует полная линейная зависимость, то все коэффициенты парной корреляции равны 1, в результате чего

.

.

2. Метод испытания гипотезы о независимости переменных. В этом случае нулевая гипотеза , доказано, что величина ![]() имеет приближенное распределение с числом степеней свободы .

имеет приближенное распределение с числом степеней свободы .

Если ![]() , то нулевая гипотеза отклоняется.

, то нулевая гипотеза отклоняется.

Определяя и сравнивая между собой коэффициенты множественной детерминации фактора, используя в качестве зависимой переменной последовательно каждой из факторов можно определить факторы, ответственные за мультиколлениарность, т.е. фактор с наибольшим значением величины .

Существуют следующие способы преодоления сильной межфакторной корреляции:

1) исключение из модели одного или несколько данных;

2) преобразование факторов для уменьшения корреляции;

3) совмещение уравнения регрессии, которые будут отражать не только факторы, но и их взаимодействие;

4) переход уравнения приведенной формы и др.

При построении уравнения множественной регрессии одним из важнейших этапов является отбор факторов, включаемых в модель. Различные подходы к отбору факторов на основе показателей корреляции к различным методам, среди которых наиболее применимы:

1) Метод исключения – производится отсев данных;

2) Метод включения – вводят дополнительный фактор;

3) Шаговый регрессионный анализ – исключают ранее введенный фактор.

При отборе факторов применяют следующее правило: число включаемых факторов обычно в 6-7 раз меньше объема совокупности, по которой строится модель.

Параметр не подлежит экономической интерпретации. В степенной модели нелинейное уравнение множественной регрессии коэффициенты , ,…, являются коэффициентами эластичности, которые показывают насколько, в среднем, изменится результат при изменении соответствующего фактора на 1% при неизменном воздействии остальных факторов.

1) Уравнение многофакторной регрессии:

Экономическая интерпретация полученной модели:

Квартиры в районе А стоят 15,5% дешевле, чем в районе В. При увеличении общей площади на 1 стоимость квартиры возрастает на 1,25 тыс. $. При увеличении жилой площади на 1 стоимость квартиры увеличивается на 0,2 тыс. $. При увеличении площади кухни на 1 стоимость квартиры увеличивается на 0,8 тыс. $. При увеличении этажа на среднего и крайнего увеличивается на 0,05 тыс. $. При увеличении дома на кирпичный и панельный увеличивается на 24,8 тыс. $. При увеличении срока сдачи на 1 мес. Стоимость квартиры уменьшается 0,4 тыс. $.

Минимальный объем выборки:

т.е. для получения статистической значимой модели необходимо отобрать 45 квартир и собрать по ним необходимые данные.

- 2) В модели использована 1 фиктивная переменная, наименование района, т.к. в построении модели участвуют 2 района - «а» и «б», которым присвоены количественные значения «1» и «2» соответственно.

- 3) Проверим факторы на мультиколлинеарность:

Это условие выполняется для следующих пар факторов и, и и, : .

Рассмотрим первую пару мультиколлинеарных факторов. Для исключения переменных необходимо знать, как из каждой факторных признаков связан с результативным признаком Y. Эта зависимость отражается в последней строке матрицы парной корреляции. Итак, .

Найдены мультиколлинеарные факторы.

Для устранения мультиколлинеарности используется метод исключения переменных.

Будем исключать факторы, имеющие наименьшее значение.

Рассмотрим первую пару мультиколлинеарных факторов.

Итак, . Сравнение: 0,899 >

Вторая пара; , . 0,885 > 0,690. Следовательно, в модели множества включить, т.к. его связь с результативным признаком больше, чем у. Аналогично, рассматриваются следующие пары.

Федеральное государственное бюджетное образовательное учреждение высшего профессионального образования

"Тверской государственный технический университет"

(ТвГТУ)

Кафедра "Бухгалтерский учет, анализ и аудит"

Курсовой проект

по дисциплине "Эконометрика"

Тема: "Построение и тестирование адекватности эконометрических моделей множественной регрессии: выбор функциональной формы модели"

Выполнила: студентка 3-го курса

учебной группы РБА 36-11

Антонова Н.В.

Проверила: Коновалова А.С.

- Введение

- Глава I . Аналитическая часть

- 1.1 Основы построения и тестирования адекватности экономических моделей множественной регрессии

- Глава II . Проектная часть

- 2.1 Методическое обеспечение множественной регрессии

- 2.2 Информационное обеспечение множественной регрессии

- 2.3 Числовой пример модели множественной регрессии и выводы множественной регрессии

- Заключение

- Список использованных источников

Введение

Эконометрика - это самостоятельная научная дисциплина, объединяющая совокупность теоретических результатов, приемов, методов и моделей, предназначенных для того, чтобы на базе экономической теории, экономической статистики и экономических измерений, математико-статистического инструментария придавать конкретное количественное выражение общим (качественным) закономерностям, обусловленным экономической теорией.

Целью работы является получение практических навыков построения эконометрических моделей.

Эконометрический метод складывался в преодолении следующих трудностей, искажающих результаты применения классических статистических методов (сущность новых терминов будет раскрыта в дальнейшем):

1. асимметричности связей;

2. мультиколлинеарности связей;

3. эффекта гетероскедастичности;

4. автокорреляции;

5. ложной корреляции;

6. наличия лагов.

Для описания сущности эконометрической модели удобно разбить весь процесс моделирования на шесть основных этапов:

1-й этап (постановочный) - определение конечных целей моделирования, набора участвующих в модели факторов и показателей, их роли;

2-й этап (априорный) - предмодельный анализ экономической сущности изучаемого явления, формирование и формализация априорной информации, в частности, относящейся к природе и генезису исходных статистических данных и случайных остаточных составляющих;

3-й этап (параметризация) - собственно моделирование, т.е. выбор общего вида модели, в том числе состава и формы входящих в нее связей;

4-й этап (информационный) - сбор необходимой статистической информации, т.е. регистрация значений участвующих в модели факторов и показателей на различных временных или пространственных тактах функционирования изучаемого явления;

5-й этап (идентификация модели) - статистический анализ модели и в первую очередь статистическое оценивание неизвестных параметров модели;

6-й этап (верификация модели) - сопоставление реальных и модельных данных, проверка адекватности модели, оценка точности модельных данных.

Эконометрическое моделирование реальных социально-экономических процессов и систем обычно преследует два типа конечных прикладных целей (или одну из них):

1) прогноз экономических и социально-экономических показателей, характеризующих состояние и развитие анализируемой системы;

2) имитацию различных возможных сценариев социально-экономического развития анализируемой системы (многовариантные сценарные расчеты, ситуационное моделирование).

При постановке задач эконометрического моделирования следует определить их иерархический уровень и профиль.

Анализируемые задачи могут относиться к макро - (страна, межстрановой анализ), мезо - (регионы внутри страны) и микро - (предприятия, фирмы, семьи) уровням и быть направленными на решение вопросов различного профиля инвестиционной, финансовой или социальной политики, ценообразования, распределительных отношений и т.п.

Глава I. Аналитическая часть

1.1 Основы построения и тестирования адекватности экономических моделей множественной регрессии

В настоящее время множественная регрессия - один из наиболее распространенных методов в эконометрике. Основная цель множественной регрессии - построить модель с большим числом факторов, определив при этом влияние каждого из них в отдельности, а также совокупное их воздействие на моделируемый показатель.

Множественная регрессия широко используется в решении проблем спроса, доходности акций, при изучении функции издержек производства, в макроэкономических расчетах и целом ряде других вопросов эконометрики. В настоящее время множественная регрессия - один из наиболее распространенных методов в эконометрике.

Основная цель множественной регрессии - построить модель с большим числом факторов, определив при этом влияние каждого из них в отдельности, а также совокупное их воздействие на моделируемый показатель.

Линейная модель множественной регрессии имеет общий вид:

y 1 = в 0 + в 1 х i1 + в 2 х i2 +…+ в m х im + е

где n - объём выборки, который по крайней мере в 3 раза превосходит количество независимых переменных;

у i - значение результативной переменной в наблюдении I;

х i1 , х i2 , ., х im -значения независимых переменных в наблюдении i ;

в 0 , в 1 , … в m - параметры уравнения регрессии, подлежащие оценке;

е - значение случайной ошибки модели множественной регрессии в наблюдении I ,

При построении модели множественной линейной регрессии учитываются следующие пять условий:

1. величины х i1 , х i2 ,., х im - неслучайные и независимые переменные;

2. математическое ожидание случайной ошибки уравнения регрессии равно нулю во всех наблюдениях: М (е) = 0, i= 1,m ;

3. дисперсия случайной ошибки уравнения регрессии является постоянной для всех наблюдений: D (е) =у 2 =const;

4. случайные ошибки модели регрессии не коррелируют между собой (ковариация случайных ошибок любых двух разных наблюдений равна нулю): соv (е i ,е j .) = 0, i?j ;

5. случайная ошибка модели регрессии - случайная величина, подчиняющаяся нормальному закону распределения с нулевым математическим ожиданием и дисперсией у 2 .

Функция , оп исывающая зависимость показателя от параметров, называется уравнением (функцией) регрессии.

Уравнение регрессии показывает ожидаемое значение зависимой переменной при определенных значениях зависимых переменных.

В зависимости от количества включенных в модель факторов Х модели делятся на однофакторные (парная модель регрессии) и многофакторные (модель множественной регрессии).

В зависимости от вида функции модели делятся на линейные и нелинейные.

Модель множественной линейной регрессии имеет вид:

y i = 0 + 1 x i 1 + 2 x i 2 +…+ k x i k + i (1.1)

- количество наблюдений.

множественная регрессия экономическая модель

Коэффициент регрессии j показывает, на какую величину в среднем изменится результативный признак , если переменную x j увеличить на единицу измерения, т.е. j является нормативным коэффициентом.

Коэффициент может быть отрицательным. Это означает, что область существования показателя не включает нулевых значений параметров. Если же а0>0 , то область существования показателя включает нулевые значения параметров, а сам коэффициент характеризует среднее значение показателя при отсутствии воздействий параметров.

Анализ уравнения (1.1) и методика определения параметров становятся более наглядными, а расчетные процедуры существенно упрощаются, если воспользоваться матричной формой записи:

Где - вектор зависимой переменной размерности п 1 , представляющий собой п наблюдений значений.

Матрица п наблюдений независимых переменных, размерность матрицы равна п ( k +1 ). Дополнительный фактор, состоящий из единиц, вводится для вычисления свободного члена. В качестве исходных данных могут быть временные ряды или пространственная выборка.

Количество факторов, включенных в модель.

a - подлежащий оцениванию вектор неизвестных параметров размерности (k +1 ) 1 ;

Вектор случайных отклонений (возмущений) размерности п 1. отражает тот факт, что изменение будет неточно описываться изменением объясняющих переменных, так как существуют и другие факторы, неучтенные в данной модели.

Таким образом,

Y = , X = , a = .

Уравнение (1.2) содержит значения неизвестных параметров 0 , 1 , 2 ,… , k .

Эти величины оцениваются на основе выборочных наблюдений, поэтому полученные расчетные показатели не являются истинными, а представляют собой лишь их статистические оценки.

Модель линейной регрессии, в которой вместо истинных значений параметров подставлены их оценки (а именно такие регрессии и применяются на практике), имеет

где A - вектор оценок параметров; е - вектор "оцененных" отклонений регрессии, остатки регрессии е = Y - ХА ; -оценка значений Y , равная ХА .

Построение уравнения регрессии осуществляется, как правило, методом наименьших квадратов (МНК), суть которого состоит в минимизации суммы квадратов отклонений фактических значений результатного признака от его расчетных значений, т.е.:

Формулу для вычисления параметров регрессионного уравнения по методу наименьших квадратов приведем без вывода

Для того чтобы регрессионный анализ, основанный на обычном методе наименьших квадратов, давал наилучшие из всех возможных результаты, должны выполняться следующие условия, известные как условия Гаусса - Маркова.

Первое условие. Математическое ожидание случайной составляющей в любом наблюдении должно быть равно нулю . Иногда случайная составляющая будет положительной, иногда отрицательной, но она не должна иметь систематического смещения ни в одном из двух возможных направлений.

Фактически если уравнение регрессии включает постоянный член, то обычно это условие выполняется автоматически, так как роль константы состоит в определении любой систематической тенденции, которую не учитывают объясняющие переменные, включенные в уравнение регрессии.

Второе условие означает, что дисперсия случайной составляющей должна быть постоянна для всех наблюдений . Иногда случайная составляющая будет больше, иногда меньше, однако не должно быть априорной причины для того, чтобы она порождала большую ошибку в одних наблюдениях, чем в других.

Эта постоянная дисперсия обычно обозначается, или часто в более краткой форме, а условие записывается следующим образом:

Выполнимость данного условия называется гомоскедастичностью (постоянством дисперсии отклонений). Невыполнимость данной предпосылки называется гетероскедастичностью, (непостоянством дисперсии отклонений).

Третье условие предполагает отсутствие систематической связи между значениями случайной составляющей в любых двух наблюдениях. Например, если случайная составляющая велика и положительна в одном наблюдении, это не должно обусловливать систематическую тенденцию к тому, что она будет большой и положительной в следующем наблюдении. Случайные составляющие должны быть независимы друг от друга.

В силу того, что, данное условие можно записать следующим образом:

Возмущения не коррелированны (условие независимости случайных составляющих в различных наблюдениях).

Это условие означает, что отклонения регрессии (а значит, и сама зависимая переменная) не коррелируют. Условие некоррелируемости ограничительно, например, в случае временного ряда. Тогда третье условие означает отсутствие автокорреляции ряда. Четвертое условие состоит в том, что в модели (1.1) возмущение (или зависимая переменная) есть величина случайная, а объясняющая переменная - величина неслучайная.

Если это условие выполнено, то теоретическая ковариация между независимой переменной и случайным членом равна нулю.

Наряду с условиями Гаусса - Маркова обычно также предполагается нормальность распределения случайного члена.

Качество модели регрессии связывают с адекватностью модели наблюдаемым (эмпирическим) данным. Проверка адекватности (или соответствия) модели регрессии наблюдаемым данным проводится на основе анализа остатков - .

Анализ остатков позволяет получить представление, насколько хорошо подобрана сама модель и насколько правильно выбран метод оценки коэффициентов. Согласно общим предположениям регрессионного анализа, остатки должны вести себя как независимые (в действительности, почти независимые) одинаково распределенные случайные величины.

Качество модели регрессии оценивается по следующим направлениям:

проверка качества всего уравнения регрессии;

проверка значимости всего уравнения регрессии;

проверка статистической значимости коэффициентов уравнения регрессии;

проверка выполнения предпосылок МНК.

При анализе качества модели регрессии, в первую очередь, используется коэффициент детерминации, который определяется следующим образом:

где - среднее значение зависимой переменной,

Предсказанное (расчетное) значение зависимой переменной.

Коэффициент детерминации показывает долю вариации результативного признака, находящегося под воздействием изучаемых факторов, т.е. определяет, какая доля вариации признака Y учтена в модели и обусловлена влиянием на него факторов.

Чем ближе к 1, тем выше качество модели.

Для оценки качества регрессионных моделей целесообразно также использовать коэффициент множественной корреляции (индекс корреляции) R

Данный коэффициент является универсальным, так как он отражает тесноту связи и точность модели, а также может использоваться при любой форме связи переменных.

Важным моментом является проверка значимости построенного уравнения в целом и отдельных параметров.

Оценить значимость уравнения регрессии - это означает установить, соответствует ли математическая модель, выражающая зависимость между Y и Х, фактическим данным и достаточно ли включенных в уравнение объясняющих переменных Х для описания зависимой переменной Y

Оценка значимости уравнения регрессии производится для того, чтобы узнать, пригодно уравнение регрессии для практического использования (например, для прогноза) или нет.

Для проверки значимости модели регрессии используется F-критерий Фишера. Если расчетное значение с 1 = k и 2 = (n - k - 1) степенями свободы, где k - количество факторов, включенных в модель, больше табличного при заданном уровне значимости, то модель считается значимой.

В качестве меры точности применяют несмещенную оценку дисперсии остаточной компоненты, которая представляет собой отношение суммы квадратов уровней остаточной компоненты к величине (n - k - 1), где k - количество факторов, включенных в модель. Квадратный корень из этой величины () называется стандартной ошибкой:

значимость отдельных коэффициентов регрессии проверяется по t-статистике путем проверки гипотезы о равенстве нулю j-го параметра уравнения (кроме свободного члена):

, (1.9)

где S aj - это стандартное (среднеквадратическое) отклонение коэффициента уравнения регрессии a j . Величина S aj представляет собой квадратный корень из произведения несмещенной оценки дисперсии и j - го диагонального элемента матрицы, обратной матрице системы нормальных уравнений.

где - диагональный элемент матрицы.

Если расчетное значение t-критерия с (n - k - 1) степенями свободы превосходит его табличное значение при заданном уровне значимости, коэффициент регрессии считается значимым. В противном случае фактор, соответствующий этому коэффициенту, следует исключить из модели (при этом ее качество не ухудшится).

1.2 Проблема спецификации экономических моделей множественной регрессии

Построение уравнения множественной регрессии начинается с решения вопроса о спецификации модели, который в свою очередь включает 2 круга вопросов: отбор факторов и выбор уравнения регрессии. Отбор факторов обычно осуществляется в два этапа:

1) теоретический анализ взаимосвязи результата и круга факторов, которые оказывают на него существенное влияние;

2) количественная оценка взаимосвязи факторов с результатом. При линейной форме связи между признаками данный этап сводится к анализу корреляционной матрицы (матрицы парных линейных коэффициентов корреляции): ry, y ry, x1 ryx2. ry, xm rx 1, y rx1, x2 rx2x 2. rx 2, xm.. rxm, y rxm, x1 rxm, x2. rxm, xm где ry, xj - линейный парный коэффициент корреляции, измеряющий тесноту связи между признаками y и хj j=1; m, m - число факторов. rxj, xk - линейный парный коэффициент корреляции, измеряющий тесноту связи между признаками хj и хk j,k =1; m. Факторы, включаемые во множественную регрессию, должны отвечать следующим требованиям:

1. Они должны быть количественно измеримы. Если необходимо включить в модель качественный фактор, не имеющий количественного измерения, то ему нужно придать количественную определенность (например, в модели урожайности качество почвы задается в виде баллов).

2. Каждый фактор должен быть достаточно тесно связан с результатом (т.е. коэффициент парной линейной корреляции между фактором и результатом должен быть существенным).

3. Факторы не должны быть сильно коррелированы друг с другом, тем более находиться в строгой функциональной связи (т.е. они не должны быть интеркоррелированы).

Разновидностью интеркоррелированности факторов является мультиколлинеарность - тесная линейная связь между факторами. Мультиколлинеарность может привести к нежелательным последствиям:

1) оценки параметров становятся ненадежными. Они обнаруживают большие стандартные ошибки. С изменением объема наблюдений оценки меняются (не только по величине, но и по знаку), что делает модель непригодной для анализа и прогнозирования.

2) затрудняется интерпретация параметров множественной регрессии как характеристик действия факторов в "чистом" виде, ибо факторы коррелированны; параметры линейной регрессии теряют экономический смысл;

3) становится невозможным определить изолированное влияние факторов на результативный показатель.

Мультиколлинеарность имеет место, если определитель матрицы межфакторной корреляции близок к нулю:

Если же определитель матрицы межфакторной корреляции близок к единице, то мультколлинеарности нет. Существуют различные подходы преодоления сильной межфакторной корреляции. Простейший из них - исключение из модели фактора (или факторов), в наибольшей степени ответственных за мультиколлинеарность при условии, что качество модели при этом пострадает несущественно (а именно, теоретический коэффициент детерминации - R2y (x1. xm) снизится несущественно).

Определение факторов, ответственных за мультиколлинеарность, может быть основано на анализе матрицы межфакторной корреляции. При этом определяют пару признаков-факторов, которые сильнее всего связаны между собой (коэффициент линейной парной корреляции максимален по модулю). Из этой пары в наибольшей степени ответственным за мультиколлинеарность будет тот признак, который теснее связан с другими факторами модели (имеет более высокие по модулю значения коэффициентов парной линейной корреляции).

Еще один способ определения факторов, ответственных за мультиколлинеарность основан на вычислении коэффициентов множественной детерминации (R2xj (x1,.,xj-1,xj+1,.,xm)), показывающего зависимость фактора xj от других факторов модели x1,., xj-1, x j+1,., xm. Чем ближе значение коэффициента множественной детерминации к единице, тем больше ответственность за мультиколлинеарность фактора, выступающего в роли зависимой переменной. Сравнивая между собой коэффициенты множественной детерминации для различных факторов можно проранжировать переменные по степени ответственности за мультиколлинеарность.

При выборе формы уравнения множественной регрессии предпочтение отдается линейной функции:

yi =a+b1·x1i+ b2·x2i+. + bm·xmi+ui

в виду четкой интерпретации параметров.

Данное уравнение регрессии называют уравнением регрессии в естественном (натуральном) масштабе. Коэффициент регрессии bj при факторе хj называют условно-чистым коэффициентом регрессии. Он измеряет среднее по совокупности отклонение признака-результата от его средней величины при отклонении признака-фактора хj на единицу, при условии, что все прочие факторы модели не изменяются (зафиксированы на своих средних уровнях).

Если не делать предположения о значениях прочих факторов, входящих в модель, то это означало бы, что каждый из них при изменении х j также изменялся бы (так как факторы связаны между собой), и своими изменениями оказывали бы влияние на признак-результат.

Понятие множественной регрессии тесно связано с понятием временного ряда. В зависимости от составляющих уровней временных рядов выделяют: Аддитивную, мультипликативную и смешанную модели

Временным рядом называется ряд наблюдений за значениями некоторого показателя (признака), упорядоченный в хронологической последовательности, т.е. в порядке возрастания переменной t - временного параметра. Отдельные наблюдения временного ряда называются уровнями этого ряда.

Временные ряды делятся на моментные и интервальные. В моментных временных рядах уровни характеризуют значения показателя по состоянию на определенные моменты времени. Например, моментными являются временные ряды цен на определенные виды товаров, временные ряды курсов акций, уровни которых фиксируются для конкретных чисел. Примерами моментных временных рядов могут служить также ряды численности населения или стоимости основных фондов, т.к. значения уровней этих рядов определяются ежегодно на одно и то же число.

В интервальных рядах уровни характеризуют значение показателя за определенные интервалы (периоды) времени. Примерами рядов этого типа могут служить временные ряды производства продукции в натуральном или стоимостном выражении за месяц, квартал, год и т.д.

Иногда уровни ряда представляют собой не непосредственно наблюдаемые значения, а производные величины: средние или относительные. Такие ряды называются производными. Уровни таких временных рядов получаются с помощью некоторых вычислений на основе непосредственно наблюдаемых показателей. Примерами таких рядов могут служить ряды среднесуточного производства основных видов промышленной продукции или ряды индексов цен.

Уровни ряда могут принимать детерминированные или случайные значения. Примером ряда с детерминированными значениями уровней - служит ряд последовательных данных о количестве дней в месяцах. Естественно, анализу, а в дальнейшем и прогнозированию, подвергаются ряды со случайными значениями уровней. В таких рядах каждый уровень может рассматриваться как реализация случайной величины - дискретной или непрерывной. Модели, которые построены по данным, характеризующим один объект за ряд определенных последовательных периодов, называется моделями временных рядов.

Как уже отмечалось, в модели временного ряда принято выделять две основные составляющие: детерминированную и случайную (рис.). Под детерминированной составляющей временного ряда понимают числовую последовательность, элементы которой вычисляются по определенному правилу как функция времени t. Исключив детерминированную составляющую из данных, мы получим колеблющийся вокруг нуля ряд, который может в одном предельном случае представлять чисто случайные скачки, а в другом - плавное колебательное движение. В большинстве случаев будет нечто среднее: некоторая иррегулярность и определенный систематический эффект, обусловленный зависимостью последовательных членов ряда.

Проблема спецификации экономических моделей множественной регрессии по существу решается на первых трех этапах моделирования и включает в себя:

определение конечных целей моделирования (прогноз, имитация различных сценариев социально-экономического развития анализируемой системы, управление);

определение списка экзогенных и эндогенных переменных;

определение состава анализируемой системы уравнений и тождеств, их структуры и соответственно списка предопределенных переменных;

формулировку исходных предпосылок и априорных ограничений относительно: стохастической природы остатков (в классических вариантах моделей постулируются их взаимная статистическая независимость или некоррелированность, нулевые значения их средних величин и, иногда, сохранение постоянными в процессе наблюдения значений их дисперсий - гомоскедастичностъ);

числовых значений отдельных элементов матриц коэффициентов в модели;

поведение некоторых эндогенных переменных.

Итак, спецификация модели - это первый и, быть может, важнейший шаг эконометрического исследования. От того, насколько удачно решена проблема спецификации и, в частности, насколько реалистичны наши решения и предположения относительно состава эндогенных, экзогенных и предопределенных переменных, структуры самой системы уравнений и тождеств, стохастической природы случайных остатков и конкретных числовых значений части элементов матриц коэффициентов, решающим образом зависит успех всего эконометрического моделирования.

Спецификация опирается на имеющиеся экономические теории, специальные знания или на интуитивные представления исследователя об анализируемой экономической системе. Эти априорные сведения определяют, в частности, природу матриц коэффициентов.

Например, информация (или предположение) о том, что определенные переменные непосредственно не участвуют в том или ином уравнении, означает равенство нулю соответствующих элементов в строках матриц коэффициентов. Дополнительные сведения о системе могут иметь вид ограничений на комбинации элементов матриц коэффициентов.

1.3 Последствия ошибок спецификации экономических моделей множественной регрессии

Возможные ошибки спецификации регрессионной модели:

Невключение значимых переменных

(-) Смещенность оценок коэффициентов регрессии

(-) Смещенность оценки дисперсии ошибок регрессии

(+) Меньшая вариация оценок коэффициентов регрессии

Включение незначимых переменных

(+) Несмещенность оценок коэффициентов регрессии

(+) Несмещенность оценки дисперсии ошибок регрессии

(-) Большая вариация оценок коэффициентов регрессии

Замещающие переменные, причины:

1. Необходимость показателя не была учтена при составлении выборки

2. Переменная трудноизмерима (например, уровень образования)

3. Сбор данных о переменной x1 требует значительных затрат

При оценивании модели без переменной x1 полученные оценки будут смешенными.

Последствия использования замещающих переменных:

1. Оценки коэффициентов при переменных x2,…, xk становятся несмещенными

2. Стандартные ошибки и t-статистики коэффициентов te ze

3. R2 имеет такое же значение, как и при оценивании с переменной x1

4. Коэффициент в1 нельзя оценить (оценивается только в1д1), но его стандартная ошибка и t-статистика позволяет оценить значимость x1

5. Получить оценку свободного члена модели невозможно (но она часто и не особенно важна) последствия справедливы приблизительно

Мультиколлинеарность - это понятие, которое используется для описания проблемы, когда нестрогая линейная зависимость между объясняющими переменными приводит к получению ненадежных оценок регрессии. Оценка любой регрессии будет страдать от нее в определенной степени, если только все независимые переменные не окажутся абсолютно некоррелированными.

Различные методы, которые могут быть использованы для смягчения мультиколлинеарности, делятся на две категории: к первой категории относятся попытки повысить степень выполнения четырех условий, обеспечивающих надежность оценок регрессии; ко второй категории относится использование внешней информации, но можно привнести или усилить автокорреляцию, но она может быть нейтрализована. Кроме того, можно привнести (или усилить) смещение, вызванное ошибками измерения, если поквартальные данные измерены с меньшей точностью, чем соответствующие ежегодные данные.

Глава II. Проектная часть

2.1 Методическое обеспечение множественной регрессии

Суть регрессионного анализа: построение математической модели и определение ее статистической надежности.

Вид множественной линейной модели регрессионного анализа:

Y = b 0 + b 1 x i1 +. + b j x ij +. + b k x ik + e i

где e i - случайные ошибки наблюдения, независимые между собой, имеют нулевую среднюю и дисперсию s.

Назначение множественной регрессии: анализ связи между несколькими независимыми переменными и зависимой переменной.

Экономический смысл параметров множественной регрессии Коэффициент множественной регрессии b j показывает, на какую величину в среднем изменится результативный признак Y, если переменную X j увеличить на единицу измерения, т.е. является нормативным коэффициентом.

Матричная запись множественной линейной модели регрессионного анализа:

где Y - случайный вектор - столбец размерности (n x 1) наблюдаемых значений результативного признака (y 1 , y 2 ,., y n);

X - матрица размерности наблюдаемых значений аргументов;

b - вектор - столбец размерности [ (k+1) x 1] неизвестных, подлежащих оценке параметров (коэффициентов регрессии) модели;

e - случайный вектор - столбец размерности (n x 1) ошибок наблюдений (остатков).

Задачи регрессионного анализа Основная задача регрессионного анализа заключается в нахождении по выборке объемом n оценки неизвестных коэффициентов регрессии b 0 , b 1 ,., b k . Задачи регрессионного анализа состоят в том, чтобы по имеющимся статистическим данным для переменных X i и Y:

· получить наилучшие оценки неизвестных параметров b 0 , b 1 ,., b k ;

· проверить статистические гипотезы о параметрах модели;

· проверить, достаточно ли хорошо модель согласуется со статистическими данными (адекватность модели данным наблюдений).

Построение моделей множественной регрессии состоит из следующих этапов:

1. выбор формы связи (уравнения регрессии);

2. определение параметров выбранного уравнения;

3. анализ качества уравнения и поверка адекватности уравнения эмпирическим данным, совершенствование уравнения.

Множественная регрессия:

· Множественная регрессия с одной переменной

· Множественная регрессия с двумя переменными

· Множественная регрессия с тремя переменными

Пример решения нахождения модели множественной регрессии

Множественная регрессия с двумя переменными

Модель множественной регрессии вида Y = b 0 +b 1 X 1 + b 2 X 2 ;

1) Найти неизвестные b 0 , b 1 ,b 2 можно, решим систему трехлинейных уравнений с тремя неизвестными b 0 ,b 1 ,b 2:

Для решения системы можете воспользоваться решение системы методом Крамера или использовав формулы

Для этого строим таблицу вида:

Таблица 1.

|

(x 1 -x 1ср) 2 |

(x 2 -x 2ср) 2 |

(y-y ср) (x 1 -x 1ср) |

|||||||

Выборочные дисперсии эмпирических коэффициентов множественной регрессии можно определить следующим образом:

Здесь z" jj - j-тый диагональный элемент матрицы Z -1 = (X T X) - 1 .

При этом:

где m - количество объясняющих переменных модели.

В частности, для уравнения множественной регрессии

Y = b 0 + b 1 X 1 + b 2 X 2

с двумя объясняющими переменными используются следующие формулы:

Здесь r 12 - выборочный коэффициент корреляции между объясняющими переменными X 1 и X 2 ; Sb j - стандартная ошибка коэффициента регрессии; S - стандартная ошибка множественной регрессии (несмещенная оценка).

По аналогии с парной регрессией после определения точечных оценок b j коэффициентов вj (j=1,2,…,m) теоретического уравнения множественной регрессии могут быть рассчитаны интервальные оценки указанных коэффициентов.

Доверительный интервал, накрывающий с надежностью (1-б) неизвестное значение параметра вj, определяется как

Множественная регрессия в Excel

Чтобы найти параметры множественной регреcсии средствами Excel, используется функция ЛИНЕЙН (Y; X; 0;1), где Y - массив для значений Y, где X - массив для значений X (указывается как единый массив для всех значений Х i)

Проверка статистической значимости коэффициентов уравнения множественной регрессии

Как и в случае множественной регрессии, статистическая значимость коэффициентов множественной регрессии с m объясняющими переменными проверяется на основе t-статистики: имеющей в данном случае распределение Стьюдента с числом степеней свободы v = n - m-1. При требуемом уровне значимости наблюдаемое значение t-статистики сравнивается с критической точной распределения Стьюдента.

В случае, если, то статистическая значимость соответствующего коэффициента множественной регрессии подтверждается. Это означает, что фактор Xj линейно связан с зависимой переменной Y. Если же установлен факт незначимости коэффициента b j , то рекомендуется исключить из уравнения переменную Xj. Это не приведет к существенной потере качества модели, но сделает ее более конкретной.

Для этой цели, как и в случае множественной регрессии, используется коэффициент детерминации R 2:

Справедливо соотношение 0<=R2<=1. Чем ближе этот коэффициент к единице, тем больше уравнение множественной регрессии объясняет поведение Y. Для множественной регрессии коэффициент детерминации является неубывающей функцией числа объясняющих переменных. Добавление новой объясняющей переменной никогда не уменьшает значение R 2 , так как каждая последующая переменная может лишь дополнить, но никак не сократить информацию, объясняющую поведение зависимой переменной. Иногда при расчете коэффициента детерминации для получения несмещенных оценок в числителе и знаменателе вычитаемой из единицы дроби делается поправка на число степеней свободы, т.е. вводится так называемый скорректированный (исправленный) коэффициент детерминации:

Соотношение может быть представлено вследующем виде: для m>1. С ростом значения m скорректированный коэффициент детерминации растет медленнее, чем обычный. Очевидно, что только при R 2 = 1. может принимать отрицательные значения.

Показатели F и R2 равны или не равен нулю одновременно. Если F=0, то R 2 =0, следовательно, величина Y линейно не зависит от X1,X2,…,Xm. Расчетное значение F сравнивается с критическим Fкр. Fкр, исходя из требуемого уровня значимости б и чисел степеней свободы v1 = m и v2 = n - m - 1, определяется на основе распределения Фишера. Если F>Fкр, то R 2 статистически значим.

Проверка выполнимости предпосылок МНК множественной регрессии. Статистика Дарбина-Уотсона для множественной регрессии

Статистическая значимость коэффициентов множественной регрессии и близкое к единице значение коэффициента детерминации R 2 не гарантируют высокое качество уравнения множественной регрессии. Поэтому следующим этапом проверки качества уравнения множественной регрессии является проверка выполнимости предпосылок МНК. Причины и последствия невыполнимости этих предпосылок, методы корректировки регрессионных моделей будут рассмотрены в последующих главах. В данном параграфе рассмотрим популярную в регрессионном анализе статистику Дарбина-Уотсона.

При статистическом анализе уравнения регрессии на начальном этапе часто проверяют выполнимость одной предпосылки: условия статистической независимости отклонений между собой.

При этом проверяется некоррелированность соседних величин e i , i=1,2,…n.

Для анализа коррелированности отклонений используют статистику Дарбина-Уотсона:

Критические значения d 1 и d 2 определяются на основе специальных таблиц для требуемого уровня значимости б, числа наблюдений n и количества объясняющих переменных m.

Автоматический расчет

Полностью произвести подобный расчет можно автоматически, используя популярный сервис Множественная регрессия (с оформлением в Word)

Частные коэффициенты корреляции при множественной регрессии

Частные коэффициенты (или индексы) корреляции, измеряющие влияние на у фактора х i при неизменном уровне других факторов определяются по стандартной формуле линейного коэффициента корреляции, т.е. последовательно берутся пары yx 1 ,yx 2 ,., x 1 x 2 , x 1 x 3 и так далее и для каждой пары находится коэффициент корреляции Вычисления в MS Excel. Матрицу парных коэффициентов корреляции переменных можно рассчитать, используя инструмент анализа данных Корреляция.

Для этого:

1) Выполнить команду Сервис / Анализ данных / Корреляция .

2) Указать диапазон данных;

Проверка общего качества уравнения множественной регрессии

Для этой цели, как и в случае множественной регрессии, используется коэффициент детерминации R2:

Справедливо соотношение 0 < =R2 < = 1. Чем ближе этот коэффициент к единице, тем больше уравнение множественной регрессии объясняет поведение Y.

Для множественной регрессии коэффициент детерминации является неубывающей функцией числа объясняющих переменных.

Добавление новой объясняющей переменной никогда не уменьшает значение R2, так как каждая последующая переменная может лишь дополнить, но никак не сократить информацию, объясняющую поведение зависимой переменной.

Иногда при расчете коэффициента детерминации для получения несмещенных оценок в числителе и знаменателе вычитаемой из единицы дроби делается поправка на число степеней свободы, т.е. вводится так называемый скорректированный (исправленный) коэффициент детерминации:

Соотношение может быть представлено в следующем виде:

для m>1.

С ростом значения m скорректированный коэффициент детерминации растет медленнее, чем обычный. Очевидно, что только при R 2 = 1. может принимать отрицательные значения.

Доказано, что увеличивается при добавлении новой объясняющей переменной тогда и только тогда, когда t-статистика для этой переменной по модулю больше единицы. Поэтому добавление в модель новых объясняющих переменных осуществляется до тех пор, пока растет скорректированный коэффициент детерминации.

Рекомендуется после проверки общего качества уравнения регрессии провести анализ его статистической значимости. Для этого используется F-статистика:

Показатели F и R2 равны или не равен нулю одновременно. Если F=0, то R 2 =0, следовательно, величина Y линейно не зависит от X 1 ,X 2 ,…,X m . Расчетное значение F сравнивается с критическим Fкр. Fкр, исходя из требуемого уровня значимости б и чисел степеней свободы v 1 = m и v 2 = n - m - 1, определяется на основе распределения Фишера. Если F > Fкр, то R2 статистически значим.

2.2 Информационное обеспечение множественной регрессии

По данным, представленным в таблице 2, изучается зависимость объёма валового национального продукта Y (млрд. долл.) от следующих переменных: Х 1 - потребление, млрд. долл., Х 2 - инвестиции, млрд. долл.

Таблица 2.

|

Х 1 |

|||||||||||

|

Х 2 |

1. Для заданного набора данных постройте линейную модель множественной регрессии. Оцените точность и адекватность построенного уравнения регрессии.

2. Дайте экономическую интерпретацию параметров модели.

3. Для полученной модели проверьте выполнение условия гомоскедастичности остатков, применив тест Голдфельда-Квандта.

4. Проверьте полученную модель на наличие автокорреляции остатков с помощью теста Дарбина-Уотсона.

5. Проверьте, адекватно ли предположение об однородности исходных данных в регрессионном смысле. Можно ли объединить две выборки (по первым 5 и остальным 5 наблюдениям) в одну и рассматривать единую модель регрессии Y по X?

2.3 Числовой пример модели множественной регрессии и выводы множественной регрессии

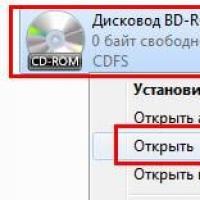

1. Построим линейную модель множественной регрессии с помощью Microsoft Office Excel. Регрессионный анализ предназначен для исследования зависимости исследуемой переменной Y от различных факторов и отображение их взаимосвязи в форме регрессионной модели.

В зависимости от количества включенных в модель факторов Х модели делятся на:

Однофакторные (парная модель регрессии).

Многофакторные (модель множественной регрессии).

Линейная модель множественной регрессии имеет вид:

=b 0 + b 1 *x 1 + b 2 *x 2 +…+ b n * x n

Для построения линейной модели множественной регрессии на листе Microsoft Office Excel (2007) создадим табличку с нашими данными (Рис.1) и построим регрессию. Для этого на закладке Данные выберем строку Анализ данных и в качестве инструмента данных - Регрессия - ок. В открывшемся окне Регрессии зададим Входной интервал Yи Х (рис.2,3).

Рис. 1. Линейная модель множественной регрессии

Рис. 2. Окно Анализ данных

Рис. 3. Окно Регрессия.

Получим результаты регрессионного анализа на новом листе Регрессия (Рис. 4)

Рис. 4. Лист Регрессия.

По данным регрессионной статистики мы получили следующие данные:

Множественный R - это vR 2 , где R 2 - коэффициент детерминации.

R -квадрат - это R 2 . В нашем примере значение R 2 =0,9883 свидетельствует о том, что изменения зависимой переменной Y (объём валового национального продукта (ВНП)) в основном (на 98,83%) можно объяснить изменениями включенных в модель объясняющих переменных - Х 1 , Х 2 (потребление и инвестиции). И лишь на 1,17% (100-98,83) объём ВНП зависит от других неучтённых факторов. Такое значение свидетельствует об адекватности модели.

Нормированный R -квадрат - поправленный (скорректированный по числу степеней свободы) коэффициент детерминации.

Стандартная ошибка регрессии S=vS 2 , где S 2 =? (е i 2 / (n-m)) - необъясненная дисперсия (мера разброса зависимой переменной вокруг линии регрессии); n - число наблюдений (в нашем случае 10), m - число объясняющих переменных (в нашем примере равно 2).

Наблюдения - число наблюдений n (10).

Рассмотрим таблицу с результатами дисперсионного анализа:

df - число степеней свободы связано с числом единиц совокупности n и с числом определяемых по ней констант (m+1).

SS - сумма квадратов (регрессионная RSS, остаточная ESS и общая TSS соответственно).

MS - сумма квадратов на одну степень свободы. MS=SS/df.

F - расчетное значение F-критерия Фишера. Если нет табличного значения, то для проверки значимости уравнения регрессии в целом можно посмотреть Значимость F. На уровне значимости б=0,05 уравнение регрессии признается значимым в целом, если Значимость F<0,05, и незначимым, если Значимость F?0,05.

Для нашего примера имеем следующие значения:

Таблица 2

|

Значимость F |

||||||

|

Регрессия |

((n-m-1) /m) =295,50 |

|||||

В нашем случае расчетное значение F-критерия Фишера составляет 295,50. Значимость F=1,74E-07, что меньше 0,05. Таким образом, полученное уравнение в целом значимо.

В последней таблице приведены значения параметров (коэффициентов) модели, их стандартные ошибки и расчетные значения t-критериев Стьюдента для оценки значимости отдельных параметров модели.

Таблица 4

|

Коэффи-циенты |

Стандарт-ная ошибка |

t-статистика |

Р-значение |

Нижние 95% |

Верхние 95% |

||

|

1,62? b 0 ? 1,11 |

|||||||

|

1,62? b 1 ? 2,56 |

|||||||

|

0,32? b 2 ? 0,79 |

Анализ данной таблицы позволяет сделать вывод о том, что на уровне значимости б=0,05 значимым оказывается лишь коэффициент при факторе X 2 , так как лишь для него Р-значение меньше 0,05. Таким образом, фактор Х 1 не существенен и его включение в модель не целесообразно. Поскольку коэффициент регрессии в экономических исследованиях имеют четкую экономическую интерпретацию, то границы доверительного интервала для коэффициента регрессии не должны содержать противоречивых результатов, как например, - 1,62? b 1 ? 2,56. Такого рода запись указывает, что истинное значение коэффициента регрессии одновременно содержит положительные и отрицательные величины и даже ноль, чего не может быть. Это также подтверждает вывод о статистической незначимости коэффициентов регрессии при факторе Х 1 . Таким образом, целесообразно исключить несущественный фактор Х 1 . Но мы оставим этот фактор, так как у нас всего 2 переменных и в случае его исключения, модель не будет многофакторной. Поэтому мы будем иметь ввиду, что фактор Х 1 малозначим и построим уравнение зависимости Y (объёма валового национального продукта) от значимой объясняющей переменной X 2 (инвестиции) и незначимой Х 1 (потребление).

Подобные документы

Описание классической линейной модели множественной регрессии. Анализ матрицы парных коэффициентов корреляции на наличие мультиколлинеарности. Оценка модели парной регрессии с наиболее значимым фактором. Графическое построение интервала прогноза.

курсовая работа , добавлен 17.01.2016

Оценка распределения переменной Х1. Моделирование взаимосвязи между переменными У и Х1 с помощью линейной функции и методом множественной линейной регрессии. Сравнение качества построенных моделей. Составление точечного прогноза по заданным значениям.

курсовая работа , добавлен 24.06.2015

Построение модели множественной линейной регрессии по заданным параметрам. Оценка качества модели по коэффициентам детерминации и множественной корреляции. Определение значимости уравнения регрессии на основе F-критерия Фишера и t-критерия Стьюдента.

контрольная работа , добавлен 01.12.2013

Факторы, формирующие цену квартир в строящихся домах в Санкт-Петербурге. Составление матрицы парных коэффициентов корреляции исходных переменных. Тестирование ошибок уравнения множественной регрессии на гетероскедастичность. Тест Гельфельда-Квандта.

контрольная работа , добавлен 14.05.2015

Выбор факторных признаков для двухфакторной модели с помощью корреляционного анализа. Расчет коэффициентов регрессии, корреляции и эластичности. Построение модели линейной регрессии производительности труда от факторов фондо- и энерговооруженности.

задача , добавлен 20.03.2010

Анализ влияния основных социально-экономических показателей на результативный признак. Особенности классической линейной модели множественной регрессии, ее анализ на наличие или отсутствие гетероскедастичности в регрессионных остатках и их автокорреляции.

лабораторная работа , добавлен 17.02.2014

Использование метода оценки параметров в стандартных масштабах для определения неизвестных параметров линейной модели множественной регрессии. Специфика изучения взаимосвязей по временным рядам. Моделирование взаимосвязей и тенденций в финансовой сфере.

контрольная работа , добавлен 22.04.2016

Построение обобщенной линейной модели множественной регрессии, ее суть; теорема Айткена. Понятие гетероскедастичности, ее обнаружение и методы смягчения проблемы: тест ранговой корреляции Спирмена, метод Голдфелда-Квандта, тесты Глейзера, Парка, Уайта.

контрольная работа , добавлен 28.07.2013

Расчет параметров A и B уравнения линейной регрессии. Оценка полученной точности аппроксимации. Построение однофакторной регрессии. Дисперсия математического ожидания прогнозируемой величины. Тестирование ошибок уравнения множественной регрессии.

контрольная работа , добавлен 19.04.2013

Понятие модели множественной регрессии. Сущность метода наименьших квадратов, который используется для определения параметров уравнения множественной линейной регрессии. Оценка качества подгонки регрессионного уравнения к данным. Коэффициент детерминации.

В предыдущих заметках предметом анализа часто становилась отдельная числовая переменная, например, доходность взаимных фондов, время загрузки Web-страницы или объем потребления безалкогольных напитков. В настоящей и следующих заметках мы рассмотрим методы предсказания значений числовой переменной в зависимости от значений одной или нескольких других числовых переменных.

Материал будет проиллюстрирован сквозным примером. Прогнозирование объема продаж в магазине одежды. Сеть магазинов уцененной одежды Sunflowers на протяжении 25 лет постоянно расширялась. Однако в настоящее время у компании нет систематического подхода к выбору новых торговых точек. Место, в котором компания собирается открыть новый магазин, определяется на основе субъективных соображений. Критериями выбора являются выгодные условия аренды или представления менеджера об идеальном местоположении магазина. Представьте, что вы - руководитель отдела специальных проектов и планирования. Вам поручили разработать стратегический план открытия новых магазинов. Этот план должен содержать прогноз годового объема продаж во вновь открываемых магазинах. Вы полагаете, что торговая площадь непосредственно связана с объемом выручки, и хотите учесть этот факт в процессе принятия решения. Как разработать статистическую модель, позволяющую прогнозировать годовой объем продаж на основе размера нового магазина?

Как правило, для предсказания значений переменной используется регрессионный анализ. Его цель - разработать статистическую модель, позволяющую предсказывать значения зависимой переменной, или отклика, по значениям, по крайней мере одной, независимой, или объясняющей, переменной. В настоящей заметке мы рассмотрим простую линейную регрессию - статистический метод, позволяющий предсказывать значения зависимой переменной Y по значениям независимой переменной X . В последующих заметках будет описана модель множественной регрессии, предназначенная для предсказания значений независимой переменной Y по значениям нескольких зависимых переменных (Х 1 , Х 2 , …, X k ).

Скачать заметку в формате или , примеры в формате

Виды регрессионных моделей

где ρ 1 – коэффициент автокорреляции; если ρ 1 = 0 (нет автокорреляции), D ≈ 2; если ρ 1 ≈ 1 (положительная автокорреляции), D ≈ 0; если ρ 1 = -1 (отрицательная автокорреляции), D ≈ 4.

На практике применение критерия Дурбина-Уотсона основано на сравнении величины D с критическими теоретическими значениями d L и d U для заданного числа наблюдений n , числа независимых переменных модели k (для простой линейной регрессии k = 1) и уровня значимости α. Если D < d L , гипотеза о независимости случайных отклонений отвергается (следовательно, присутствует положительная автокорреляция); если D > d U , гипотеза не отвергается (то есть автокорреляция отсутствует); если d L < D < d U , нет достаточных оснований для принятия решения. Когда расчётное значение D превышает 2, то с d L и d U сравнивается не сам коэффициент D , а выражение (4 – D ).

Для вычисления статистики Дурбина-Уотсона в Excel обратимся к нижней таблице на рис. 14 Вывод остатка . Числитель в выражении (10) вычисляется с помощью функции =СУММКВРАЗН(массив1;массив2), а знаменатель =СУММКВ(массив) (рис. 16).

Рис. 16. Формулы расчета статистики Дурбина-Уотсона

В нашем примере D = 0,883. Основной вопрос заключается в следующем - какое значение статистики Дурбина-Уотсона следует считать достаточно малым, чтобы сделать вывод о существовании положительной автокорреляции? Необходимо соотнести значение D с критическими значениями (d L и d U ), зависящими от числа наблюдений n и уровня значимости α (рис. 17).

Рис. 17. Критические значения статистики Дурбина-Уотсона (фрагмент таблицы)

Таким образом, в задаче об объеме продаж в магазине, доставляющем товары на дом, существуют одна независимая переменная (k = 1), 15 наблюдений (n = 15) и уровень значимости α = 0,05. Следовательно, d L = 1,08 и d U = 1,36. Поскольку D = 0,883 < d L = 1,08, между остатками существует положительная автокорреляция, метод наименьших квадратов применять нельзя.

Проверка гипотез о наклоне и коэффициенте корреляции

Выше регрессия применялась исключительно для прогнозирования. Для определения коэффициентов регрессии и предсказания значения переменной Y при заданной величине переменной X использовался метод наименьших квадратов. Кроме того, мы рассмотрели среднеквадратичную ошибку оценки и коэффициент смешанной корреляции. Если анализ остатков подтверждает, что условия применимости метода наименьших квадратов не нарушаются, и модель простой линейной регрессии является адекватной, на основе выборочных данных можно утверждать, что между переменными в генеральной совокупности существует линейная зависимость.

Применение t -критерия для наклона. Проверяя, равен ли наклон генеральной совокупности β 1 нулю, можно определить, существует ли статистически значимая зависимость между переменными X и Y . Если эта гипотеза отклоняется, можно утверждать, что между переменными X и Y существует линейная зависимость. Нулевая и альтернативная гипотезы формулируются следующим образом: Н 0: β 1 = 0 (нет линейной зависимости), Н1: β 1 ≠ 0 (есть линейная зависимость). По определению t -статистика равна разности между выборочным наклоном и гипотетическим значением наклона генеральной совокупности, деленной на среднеквадратичную ошибку оценки наклона:

(11) t = (b 1 – β 1 ) / S b 1

где b

1

– наклон прямой регрессии по выборочным данным, β1 – гипотетический наклон прямой генеральной совокупности, ![]() , а тестовая статистика t

имеет t

-распределение с n – 2

степенями свободы.

, а тестовая статистика t

имеет t

-распределение с n – 2

степенями свободы.

Проверим, существует ли статистически значимая зависимость между размером магазина и годовым объемом продаж при α = 0,05. t -критерий выводится наряду с другими параметрами при использовании Пакета анализа (опция Регрессия ). Полностью результаты работы Пакета анализа приведены на рис. 4, фрагмент, относящийся к t-статистике – на рис. 18.

Рис. 18. Результаты применения t

Поскольку число магазинов n = 14 (см. рис.3), критическое значение t -статистики при уровне значимости α = 0,05 можно найти по формуле: t L =СТЬЮДЕНТ.ОБР(0,025;12) = –2,1788, где 0,025 – половина уровня значимости, а 12 = n – 2; t U =СТЬЮДЕНТ.ОБР(0,975;12) = +2,1788.

Поскольку t -статистика = 10,64 > t U = 2,1788 (рис. 19), нулевая гипотеза Н 0 отклоняется. С другой стороны, р -значение для Х = 10,6411, вычисляемое по формуле =1-СТЬЮДЕНТ.РАСП(D3;12;ИСТИНА), приближенно равно нулю, поэтому гипотеза Н 0 снова отклоняется. Тот факт, что р -значение почти равно нулю, означает, что если бы между размерами магазинов и годовым объемом продаж не существовало реальной линейной зависимости, обнаружить ее с помощью линейной регрессии было бы практически невозможно. Следовательно, между средним годовым объемом продаж в магазинах и их размером существует статистически значимая линейная зависимость.

Рис. 19. Проверка гипотезы о наклоне генеральной совокупности при уровне значимости, равном 0,05, и 12 степенях свободы

Применение F -критерия для наклона. Альтернативным подходом к проверке гипотез о наклоне простой линейной регрессии является использование F -критерия. Напомним, что F -критерий применяется для проверки отношения между двумя дисперсиями (подробнее см. ). При проверке гипотезы о наклоне мерой случайных ошибок является дисперсия ошибки (сумма квадратов ошибок, деленная на количество степеней свободы), поэтому F -критерий использует отношение дисперсии, объясняемой регрессией (т.е. величины SSR , деленной на количество независимых переменных k ), к дисперсии ошибок (MSE = S Y X 2 ).

По определению F -статистика равна среднему квадрату отклонений, обусловленных регрессией (MSR), деленному на дисперсию ошибки (MSE): F = MSR / MSE , где MSR = SSR / k , MSE = SSE /(n – k – 1), k – количество независимых переменных в регрессионной модели. Тестовая статистика F имеет F -распределение с k и n – k – 1 степенями свободы.

При заданном уровне значимости α решающее правило формулируется так: если F > F U , нулевая гипотеза отклоняется; в противном случае она не отклоняется. Результаты, оформленные в виде сводной таблицы дисперсионного анализа, приведены на рис. 20.

Рис. 20. Таблица дисперсионного анализа для проверки гипотезы о статистической значимости коэффициента регрессии

Аналогично t -критерию F -критерий выводится в таблицу при использовании Пакета анализа (опция Регрессия ). Полностью результаты работы Пакета анализа приведены на рис. 4, фрагмент, относящийся к F -статистике – на рис. 21.

Рис. 21. Результаты применения F -критерия, полученные с помощью Пакета анализа Excel

F-статистика равна 113,23, а р -значение близко к нулю (ячейка Значимость F ). Если уровень значимости α равен 0,05, определить критическое значение F -распределения с одной и 12 степенями свободы можно по формуле F U =F.ОБР(1-0,05;1;12) = 4,7472 (рис. 22). Поскольку F = 113,23 > F U = 4,7472, причем р -значение близко к 0 < 0,05, нулевая гипотеза Н 0 отклоняется, т.е. размер магазина тесно связан с его годовым объемом продаж.

Рис. 22. Проверка гипотезы о наклоне генеральной совокупности при уровне значимости, равном 0,05, с одной и 12 степенями свободы

Доверительный интервал, содержащий наклон β 1 . Для проверки гипотезы о существовании линейной зависимости между переменными можно построить доверительный интервал, содержащий наклон β 1 и убедиться, что гипотетическое значение β 1 = 0 принадлежит этому интервалу. Центром доверительного интервала, содержащего наклон β 1 , является выборочный наклон b 1 , а его границами - величины b 1 ± t n –2 S b 1

Как показано на рис. 18, b 1 = +1,670, n = 14, S b 1 = 0,157. t 12 =СТЬЮДЕНТ.ОБР(0,975;12) = 2,1788. Следовательно, b 1 ± t n –2 S b 1 = +1,670 ± 2,1788 * 0,157 = +1,670 ± 0,342, или + 1,328 ≤ β 1 ≤ +2,012. Таким образом, наклон генеральной совокупности с вероятностью 0,95 лежит в интервале от +1,328 до +2,012 (т.е. от 1 328 000 до 2 012 000 долл.). Поскольку эти величины больше нуля, между годовым объемом продаж и площадью магазина существует статистически значимая линейная зависимость. Если бы доверительный интервал содержал нуль, между переменными не было бы зависимости. Кроме того, доверительный интервал означает, что каждое увеличение площади магазина на 1 000 кв. футов приводит к увеличению среднего объема продаж на величину от 1 328 000 до 2 012 000 долларов.

Использование t -критерия для коэффициента корреляции. был введен коэффициент корреляции r , представляющий собой меру зависимости между двумя числовыми переменными. С его помощью можно установить, существует ли между двумя переменными статистически значимая связь. Обозначим коэффициент корреляции между генеральными совокупностями обеих переменных символом ρ. Нулевая и альтернативная гипотезы формулируются следующим образом: Н 0 : ρ = 0 (нет корреляции), Н 1 : ρ ≠ 0 (есть корреляция). Проверка существования корреляции:

где r = + , если b 1 > 0, r = – , если b 1 < 0. Тестовая статистика t имеет t -распределение с n – 2 степенями свободы.

В задаче о сети магазинов Sunflowers r 2 = 0,904, а b 1 - +1,670 (см. рис. 4). Поскольку b 1 > 0, коэффициент корреляции между объемом годовых продаж и размером магазина равен r = +√0,904 = +0,951. Проверим нулевую гипотезу, утверждающую, что между этими переменными нет корреляции, используя t -статистику:

При уровне значимости α = 0,05 нулевую гипотезу следует отклонить, поскольку t = 10,64 > 2,1788. Таким образом, можно утверждать, что между объемом годовых продаж и размером магазина существует статистически значимая связь.

При обсуждении выводов, касающихся наклона генеральной совокупности, доверительные интервалы и критерии для проверки гипотез являются взаимозаменяемыми инструментами. Однако вычисление доверительного интервала, содержащего коэффициент корреляции, оказывается более сложным делом, поскольку вид выборочного распределения статистики r зависит от истинного коэффициента корреляции.

Оценка математического ожидания и предсказание индивидуальных значений

В этом разделе рассматриваются методы оценки математического ожидания отклика Y и предсказания индивидуальных значений Y при заданных значениях переменной X .

Построение доверительного интервала. В примере 2 (см. выше раздел Метод наименьших квадратов ) регрессионное уравнение позволило предсказать значение переменной Y X . В задаче о выборе места для торговой точки средний годовой объем продаж в магазине площадью 4000 кв. футов был равен 7,644 млн. долл. Однако эта оценка математического ожидания генеральной совокупности является точечной. для оценки математического ожидания генеральной совокупности была предложена концепция доверительного интервала. Аналогично можно ввести понятие доверительного интервала для математического ожидания отклика при заданном значении переменной X :

где  , =

b

0

+

b

1

X i

– предсказанное значение переменное Y

при X

= X i

, S YX

– среднеквадратичная ошибка, n

– объем выборки, X

i

- заданное значение переменной X

, µ

Y

| X

=

X

i

– математическое ожидание переменной Y

при Х

= Х i

, SSX =

, =

b

0

+

b

1

X i

– предсказанное значение переменное Y

при X

= X i

, S YX

– среднеквадратичная ошибка, n

– объем выборки, X

i

- заданное значение переменной X

, µ

Y

| X

=

X

i

– математическое ожидание переменной Y

при Х

= Х i

, SSX =

Анализ формулы (13) показывает, что ширина доверительного интервала зависит от нескольких факторов. При заданном уровне значимости возрастание амплитуды колебаний вокруг линии регрессии, измеренное с помощью среднеквадратичной ошибки, приводит к увеличению ширины интервала. С другой стороны, как и следовало ожидать, увеличение объема выборки сопровождается сужением интервала. Кроме того, ширина интервала изменяется в зависимости от значений X i . Если значение переменной Y предсказывается для величин X , близких к среднему значению , доверительный интервал оказывается уже, чем при прогнозировании отклика для значений, далеких от среднего.

Допустим, что, выбирая место для магазина, мы хотим построить 95%-ный доверительный интервал для среднего годового объема продаж во всех магазинах, площадь которых равна 4000 кв. футов:

Следовательно, средний годовой объем продаж во всех магазинах, площадь которых равна 4 000 кв. футов, с 95% -ной вероятностью лежит в интервале от 6,971 до 8,317 млн. долл.

Вычисление доверительного интервала для предсказанного значения. Кроме доверительного интервала для математического ожидания отклика при заданном значении переменной X , часто необходимо знать доверительный интервал для предсказанного значения. Несмотря на то что формула для вычисления такого доверительного интервала очень похожа на формулу (13), этот интервал содержит предсказанное значение, а не оценку параметра. Интервал для предсказанного отклика Y X = Xi при конкретном значении переменной X i определяется по формуле:

Предположим, что, выбирая место для торговой точки, мы хотим построить 95%-ный доверительный интервал для предсказанного годового объема продаж в магазине, площадь которого равна 4000 кв. футов:

Следовательно, предсказанный годовой объем продаж в магазине, площадь которого равна 4000 кв. футов, с 95%-ной вероятностью лежит в интервале от 5,433 до 9,854 млн. долл. Как видим, доверительный интервал для предсказанного значения отклика намного шире, чем доверительный интервал для его математического ожидания. Это объясняется тем, что изменчивость при прогнозировании индивидуальных значений намного больше, чем при оценке математического ожидания.

Подводные камни и этические проблемы, связанные с применением регрессии

Трудности, связанные с регрессионным анализом:

- Игнорирование условий применимости метода наименьших квадратов.

- Ошибочная оценка условий применимости метода наименьших квадратов.

- Неправильный выбор альтернативных методов при нарушении условий применимости метода наименьших квадратов.

- Применение регрессионного анализа без глубоких знаний о предмете исследования.

- Экстраполяция регрессии за пределы диапазона изменения объясняющей переменной.

- Путаница между статистической и причинно-следственной зависимостями.

Широкое распространение электронных таблиц и программного обеспечения для статистических расчетов ликвидировало вычислительные проблемы, препятствовавшие применению регрессионного анализа. Однако это привело к тому, что регрессионный анализ стали применять пользователи, не обладающие достаточной квалификацией и знаниями. Откуда пользователям знать об альтернативных методах, если многие из них вообще не имеют ни малейшего понятия об условиях применимости метода наименьших квадратов и не умеют проверять их выполнение?

Исследователь не должен увлекаться перемалыванием чисел - вычислением сдвига, наклона и коэффициента смешанной корреляции. Ему нужны более глубокие знания. Проиллюстрируем это классическим примером, взятым из учебников. Анскомб показал, что все четыре набора данных, приведенных на рис. 23, имеют одни и те же параметры регрессии (рис. 24).

Рис. 23. Четыре набора искусственных данных

Рис. 24. Регрессионный анализ четырех искусственных наборов данных; выполнен с помощью Пакета анализа (кликните на рисунке, чтобы увеличить изображение)

Итак, с точки зрения регрессионного анализа все эти наборы данных совершенно идентичны. Если бы анализ был на этом закончен, мы потеряли бы много полезной информации. Об этом свидетельствуют диаграммы разброса (рис. 25) и графики остатков (рис. 26), построенные для этих наборов данных.

Рис. 25. Диаграммы разброса для четырех наборов данных

Диаграммы разброса и графики остатков свидетельствуют о том, что эти данные отличаются друг от друга. Единственный набор, распределенный вдоль прямой линии, - набор А. График остатков, вычисленных по набору А, не имеет никакой закономерности. Этого нельзя сказать о наборах Б, В и Г. График разброса, построенный по набору Б, демонстрирует ярко выраженную квадратичную модель. Этот вывод подтверждается графиком остатков, имеющим параболическую форму. Диаграмма разброса и график остатков показывают, что набор данных В содержит выброс. В этой ситуации необходимо исключить выброс из набора данных и повторить анализ. Метод, позволяющий обнаруживать и исключать выбросы из наблюдений, называется анализом влияния. После исключения выброса результат повторной оценки модели может оказаться совершенно иным. Диаграмма разброса, построенная по данным из набора Г, иллюстрирует необычную ситуацию, в которой эмпирическая модель значительно зависит от отдельного отклика (Х 8 = 19, Y 8 = 12,5). Такие регрессионные модели необходимо вычислять особенно тщательно. Итак, графики разброса и остатков являются крайне необходимым инструментом регрессионного анализа и должны быть его неотъемлемой частью. Без них регрессионный анализ не заслуживает доверия.

Рис. 26. Графики остатков для четырех наборов данных

Как избежать подводных камней при регрессионном анализе:

- Анализ возможной взаимосвязи между переменными X и Y всегда начинайте с построения диаграммы разброса.

- Прежде чем интерпретировать результаты регрессионного анализа, проверяйте условия его применимости.

- Постройте график зависимости остатков от независимой переменной. Это позволит определить, насколько эмпирическая модель соответствует результатам наблюдения, и обнаружить нарушение постоянства дисперсии.

- Для проверки предположения о нормальном распределении ошибок используйте гистограммы, диаграммы «ствол и листья», блочные диаграммы и графики нормального распределения.

- Если условия применимости метода наименьших квадратов не выполняются, используйте альтернативные методы (например, модели квадратичной или множественной регрессии).

- Если условия применимости метода наименьших квадратов выполняются, необходимо проверить гипотезу о статистической значимости коэффициентов регрессии и построить доверительные интервалы, содержащие математическое ожидание и предсказанное значение отклика.

- Избегайте предсказывать значения зависимой переменной за пределами диапазона изменения независимой переменной.

- Имейте в виду, что статистические зависимости не всегда являются причинно-следственными. Помните, что корреляция между переменными не означает наличия причинно-следственной зависимости между ними.

Резюме. Как показано на структурной схеме (рис. 27), в заметке описаны модель простой линейной регрессии, условия ее применимости и способы проверки этих условий. Рассмотрен t -критерий для проверки статистической значимости наклона регрессии. Для предсказания значений зависимой переменной использована регрессионная модель. Рассмотрен пример, связанный с выбором места для торговой точки, в котором исследуется зависимость годового объема продаж от площади магазина. Полученная информация позволяет точнее выбрать место для магазина и предсказать его годовой объем продаж. В следующих заметках будет продолжено обсуждение регрессионного анализа, а также рассмотрены модели множественной регрессии.

Рис. 27. Структурная схема заметки

Используются материалы книги Левин и др. Статистика для менеджеров. – М.: Вильямс, 2004. – с. 792–872

Если зависимая переменная является категорийной, необходимо применять логистическую регрессию.